作用

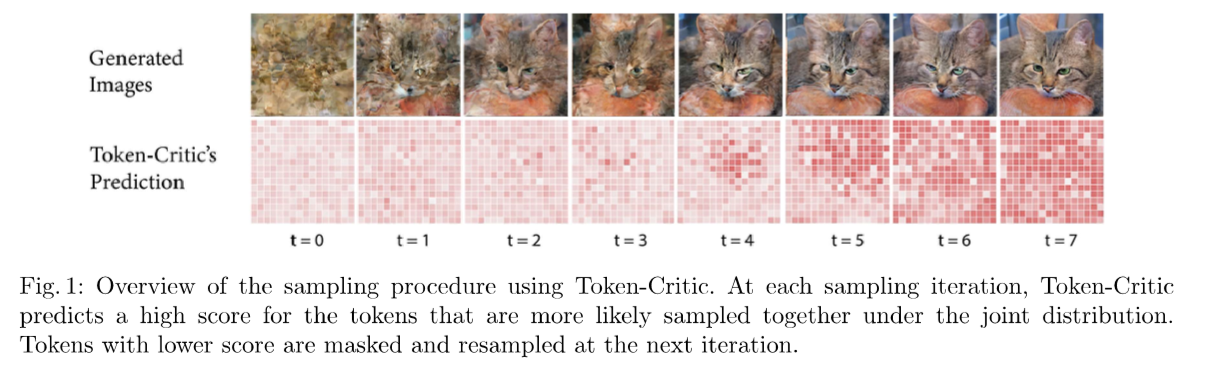

Token-Critic 用来判断 which visual tokens belong to the original image and which were sampled by the generative transformer. 在非自回归的生成中知道哪些 tokens 需要保留哪些 tokens 需要被替换是一件比较困难的事情,所以 token-critic (一个 transformer 模型) 被提出用来解决这个问题。

Token-Critic 解决了三个关键的限制问题:

token 掩码委托给 Token-Critic 模型

- Token-Critic 模型经过训练,能够区分哪些 token 属于真实分布,哪些不属于

- 它学习判断每个 visual token 的质量和真实性

迭代采样过程中的精确掩码

- 在每次迭代中,Token-Critic 不是简单地丢弃采样的 token,而是能够精确地识别出质量较差的 token

- 这使得模型能够保留高质量的生成 token,同时替换掉不符合真实分布的 token

改进的采样程序

- 传统方法可能会在迭代解码过程中错误地丢弃已经正确采样的 token

- Token-Critic 通过精确的质量评估,避免了这种误删除,从而提升了整体生成质量

Token-Critic 的结构

Transformer 结构,输出的结果为每个 token 的得分,表示在根据 condition 的情况下生成的 token 的质量。

1 | import torch |